APN/LUCAS BARTH

Praxis

Alexa, Siri und die Ethik

Selbstfahrende Autos, Sprachassistenten wie „Alexa“ und "Siri", Pflegeroboter, automatisierte Finanztransaktionen und präzise medizinische Diagnosen: Künstliche Intelligenz, kurz KI, sollte die Welt und unsere Gesellschaft nachhaltig zum Positiven verändern. Doch gibt es dafür auch ethische Richtlinien?

21. Februar 2020, 02:00

Sendung hören

Praxis | 22 01 2020 | 16:05 Uhr

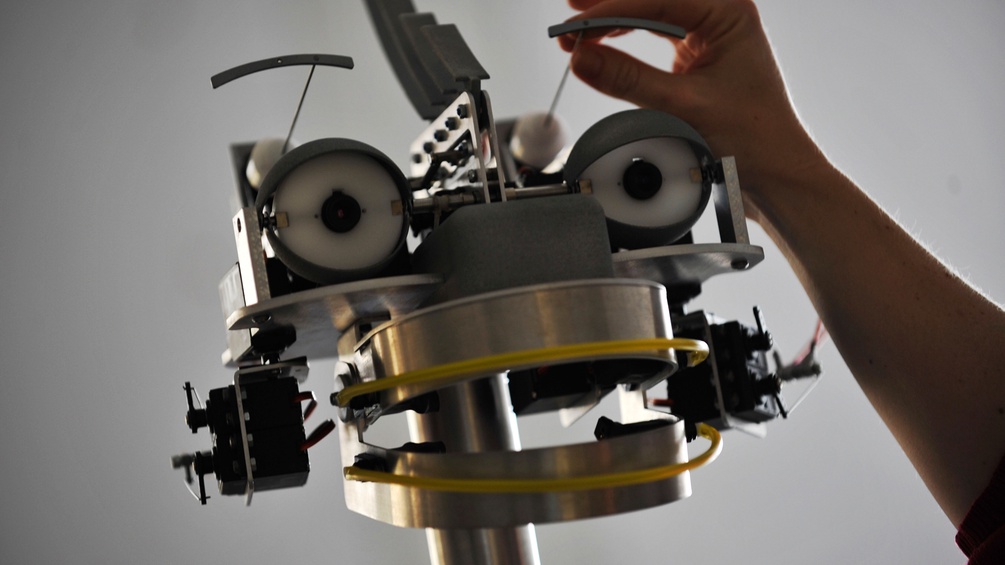

Mit dem Überbegriff "Künstliche Intelligenz", kurz KI oder AI "Artificial Intelligence" auf Englisch werden Systeme mit sogenanntem „intelligenten“ Verhalten bezeichnet, die ihre Umgebung analysieren und zu einem gewissen Grad autonom handeln. Dazu zählen neben Sprachassistenten auch Bildanalysesoftware, Suchmaschinen sowie Sprach- und Gesichtserkennungssysteme.

"Wird das, was wir können, durch die Tugenden, die lebenspraktischen und lebensfördernden Haltungen, geprüft?"

Künstliche Intelligenz ist aus der Perspektive der Religion betrachtet weder gut noch böse, sagt Herr Ehrl, Augustiner Chorherr und Kustos des Stiftes St. Florian: „Wir können, meinen manche, ohnehin schon fast alles. Auch die Welt pulverisieren. Die Frage ist, ob das, was wir können, durch die Tugenden, die lebenspraktischen und lebensfördernden Haltungen, geprüft wird: Bedenke die Folgen! Ist das klug, was Du tust? Wäre weniger vielleicht besser? Sollen wir alles machen, was wir können? Dient das dem Menschen? Dient das der Verbesserung, der Vertiefung von Lebensmöglichkeiten?“

"Robotik soll soziale Kontakte ergänzen, nicht ersetzen."

"Artificial Intelligence, Künstliche Intelligenz" hat in unterschiedlichen Bereichen des Lebens längst Einzug gehalten. Sogenannte "digitale Sprachassistenten" zum Beispiel gehören zu den erfolgreichsten technologischen Entwicklungen der vergangenen Jahre, erleichtern das Leben und sind für viele unentbehrlich geworden.

Trotzdem stellt die, weltweit erste, Professorin für Roboterpsychologie, Martina Mara, im Zuge ihrer Forschung immer wieder fest, dass viele Menschen auch große Angst hätten vor einer Zukunft, „in der der Faktor Mensch oder die zwischenmenschliche Kommunikation auf die maschinelle Ebene umschwenkt“.

Viele Menschen hätten Angst vor sozialer Isolation oder „vor dystopischen Zukunftsbildern, in denen man nur noch von Maschinen umgeben ist, die sich den eigenen Wünschen und Bedürfnissen ganz individualisiert anpassen und keiner mehr Lust auf den realen menschlichen Kontakt hat“, beschreibt Martina Mara von der Johannes Kepler Universität Linz. Sie ist auch Mitglied des "Österreichischen Rats für Robotik und Künstliche Intelligenz". Ihrer Meinung nach soll Robotik soziale Kontakte ergänzen, nicht ersetzen.

"Die Probleme, die uns beim Bau von Robotern begegnen führen uns natürlich in manchen Fällen zu Fragen von Leben und Tod.“

Insbesondere in Einrichtungen für betagte Menschen kommen sogenannte "Pflegeroboter" zum Einsatz. Noch dienen sie mehr der Unterhaltung. Doch werden sie in Zukunft auch Menschen pflegen? Medikamente verabreichen? Wer programmiert sie? Wer haftet bei Fehlern?

Auch hier stellt sich die Frage der Ethik, bekräftigt Janina Loh, Technikphilosophin und Roboterethikerin an der Universität Wien: Roboter, als konkrete Produkte menschlichen Handelns, hätten immer schon ethische Werte in ihrem Bau, in ihrem Design mit enthalten. Selbst einem Staubsauger-Roboter seien ethische Werte implementiert, bringt sie als Beispiel: „in dem Sinn, dass er etwa nicht über den Schwanz der Katze fahren soll.“

Von der Katze zum Menschen ist es dann nur ein Katzensprung. Fahrzeuge mit einem hohen Automatisierungsgrad entscheiden im Ernstfall aufgrund ihrer Programmierung, wie und ob sie einer Gruppe von Fußgängern ausweichen, so Loh. Die ethischen Probleme würden eben schon beim Staubsauger-Roboter beginnen und nicht erst beim Militär-Roboter, meint die Technikphilosophin. „Es sind letztlich immer dieselben Probleme oder Herausforderungen, die uns da begegnen beim Bau von Robotern, die natürlich in manchen Fällen zu Fragen von Leben und Tod führen.“

Wenn nun also Geräte mit Künstlicher Intelligenz Entscheidungen treffen, dann muss sichergestellt werden, dass dies nicht abseits von Moral, ethischen Grundhaltungen und gesetzlichen Regeln geschieht, sagt Loh. Für die EU hat eine Expertengruppe daher "Ethische Leitlinien für vertrauenswürdige KI" erarbeitet. Damit sei ein grober Rahmen gesteckt, stellt die Roboterethikerin generell fest.

„Wir wissen nicht, was dann tatsächlich mit den Daten passiert“.

Fakt ist, dass tagtäglich weltweit von Geräten, die auf Basis von KI funktionieren, eine Fülle von Daten gesammelt wird. Es geht um die Prävention von Cyberkriminalität, von Beeinflussung, von Diskriminierung - und um die Erfüllung von Datenschutz-Prinzipien.

„Wir wissen nicht, was dann tatsächlich mit den Daten passiert“, sagt Iwona Laub von "epicenter.works", einem kritischen Verein mit den Schwerpunkten Datenschutz und Bürgerrechte. Daher kommt der "Datenschutz-Grundverordnung", kurz DSGVO, eine wichtige Rolle zu. Seit Mai 2018 ist sie die Grundlage des allgemeinen Datenschutzrechts in der EU und in Österreich.

Am Beginn hätten alle über ihre Einführung geflucht, meint Laub, doch „in Wirklichkeit haben wir einen extrem hohen Datenschutzstandard, den es sonst auf der Welt so nicht gibt.“ Ein Standard, der auch stetig auf neu hinzukommende Bereiche ausgeweitet werden müsse, meint die Datenschützerin.

Künstliche Intelligenz ist weder gut noch böse.

Die Gefahr, die von gesammelten und gespeicherten Daten ausgehen könne, scheint im Bewusstsein vieler Menschen allerdings noch nicht verankert zu sein. Viele, zu viele Menschen seien nach wie vor sehr blauäugig und geben ihre Daten ohne viel nachzudenken preis, beklagt Laub.

Expertinnen und Experten raten zu einem bewusst kritischen Umgang, auch wenn sie „Artificial Intelligence“, Künstliche Intelligenz, per se weder als gut noch als böse bezeichnen wollen. Es kommt darauf an, wer was zu welchem Zweck und in welchem Umfeld damit macht, so die Conclusio.